摘要:智能技术在教育领域的广泛应用,引发了一系列教育主体失范问题。对此,文章首先通过对访谈数据和客观数据的概念提取与整合分析,形成了教育主体失范风险的影响因素集合,共包含41项影响因素条目。随后,文章以生成式人工智能为研究对象,依托多层次治理理论和体制复合体理论,结合影响因素分析,构建了教育领域中生成式人工智能的多层次治理模型。最后,文章从建立伦理规范、完善监管机制、推动立法进程、落实实际行动等角度,提出了实施生成式人工智能常态化治理的实践路径。文章的研究能够为国家有关部门政策的制定提供理论指导、为各类教育主体行为规制提供参照,并支持以生成式人工智能为代表的新型教育智能产品准入与评测标准的制定,推动我国实现智能教育的安全、健康、可持续发展。

关键词:教育主体失范;多层次治理;生成式人工智能;智能技术

一 问题的提出

智能技术作为教育改革的重要推动力量,其辐射的作用力已经从班级、学校、区域扩大至整个社会层面[1]。教育系统是社会系统中重要的子系统,教育治理是社会治理的前置阶段。随着智能技术在教育领域应用的逐渐深入,智能技术应用不当、治理机制缺位、技术主体缺乏风险意识等不足引发了一系列的教育问题和社会问题。学术研究和实践领域已经意识到,教育领域中应用的智能技术影响了主体的行动过程乃至引发了负面结果,其中以智能技术引发的教育主体失范问题影响较大、负面效果波及对象较广[2],导致出现了“智能技术引发教育价值危机”“教育失去控制”“价值选择和方向出现偏差”等质疑[3]。对教育领域中的智能技术开展治理,既是解决教育系统效率和质量问题的关键,也是提升社会治理效率和质量的重要维度[4],而这需要首先厘清教育领域中智能技术应用不当、主体失范等问题的具体类型或表现。对此,不同研究者提出了不同的分类方式,如通过明确智能技术引发各类型教育主体失范的判定标准,进一步梳理出过程性失范、转型期失范、周期性失范、本质性失范、原生性失范等五种表现类型[5]。在整合已有研究的基础上,本研究梳理出四种智能技术引发的教育主体失范:①背离伦理(道德)规范的失范,具体表现为教育主体在智能技术应用中迷失理性[6]、产生教育与技术结合的认知偏差[7],甚至违反教育原则[8]、缺乏对技术应用不良后果的责任承担[9]、算法控制[10]等;②违反行业与技术标准的失范,主要有技术研发人员不遵守行业标准、刻意模糊数据权属、容忍设计缺陷等[11];③脱离制度约束的失范,主要涉及过度创设场景[12]、偏离教育目标[13]、技术—制度逻辑悖论[14]、违反教育规律[15]等;④触犯法律底线的失范,如无视教育良序、算法绑架、非法买卖或泄露隐私等[16],更为严重的是通过智能技术定向推送错误的知识从而误导学习者的认知发展,乃至走上经济犯罪的道路等。针对智能技术引发的教育主体失范,已有研究从多角度进行了归因阐释,如人工智能技术教育应用的开发与设计标准缺失[17]、教育治理缺乏规范性等[18]。然而,对智能技术开发、使用过程中各类主体的治理与规制,才是解决智能时代技术问题的根本。基于此,本研究将焦点对准智能技术环境下教育实践活动的参与主体,重点探索智能技术环境下导致他们产生失范的影响因素,并理解这些影响因素之间的相互作用等。通过对智能技术引发教育主体失范归因的分析,来寻找“科林格里奇困境”产生的本质原因,并以此为基础探讨如何规制智能技术环境下的教育主体行为,为未来教育政策的制定与落地提供指导,为教育主体实施干预、设计治理体系和完善治理机制提供参考依据,进而实现智能教育的安全、健康、可持续发展。

二 研究设计

1 研究过程与方法

在数据收集与分析阶段,本研究采用访谈法(包含基于案例的访谈)收集主观数据,并辅以客观数据进行三角互证,从而补充影响因素集合,保证因素提取的科学性和全面性。访谈过程中开展基于案例的追问,基本原则是了解教育主体的价值倾向、避免悬置评估、关注远景预判。最后基于访谈数据、客观数据等资料,提取教育领域中技术主体失范的成因。

2 数据收集

(1)访谈对象选取与数据收集

本研究共访谈了42位专家,涵盖政府管理人员(占比 19%)、基础教育一线教师(占比 28.6%)、教育科技企业的实践人员(占比 14.3%)、高校教师等科研人员(占比 11.9%)、家长(占比 26.2%)五大群体。访谈由3名研究者共同推进,其中1名作为主访、2名研究人员进行辅助提问和现场记录,每位访谈对象的访谈时间约为 40~60 分钟。访谈采取半结构化访谈与结构化访谈相结合的方式:首先开展半结构化访谈,与访谈对象围绕智能技术在教育领域应用的现象和典型案例等展开讨论,主要关注访谈对象对教育领域智能技术应用风险的思考与认识;然后在第一阶段访谈对象回应的基础上,分析多元教育主体对智能技术引发行为失范的理解差异,并基于多元角色的实践经历,有针对性地开展结构化访谈,依据访谈对象的身份与角色(如教师、家长、管理者等)选择相应的个性化访谈问题。其中,访谈问题的设计围绕四种智能技术引发的教育主体失范展开,主要探寻多元教育主体对当下智能技术引发的教育问题的认识及其对解决方案的期望,如基础教育阶段教师的访谈问题主要涉及学生在智能技术环境下的行为表现、技术引发的教育风险、相应的课程设计、技术规制或干预方式等。

(2)客观数据的收集与筛选

客观数据涉及政策文件、文献研究、互联网数据等多种类型的数据来源。访谈数据旨在挖掘存在于教育主体潜意识层面的归因分析,而客观数据能够补充访谈所获得的数据维度,进一步提高数据的全面性和科学性,并且通过收集和分析研究主题相关的客观数据,能够实现三角互证[19]。客观数据的筛选和纳入原则由本研究团队讨论制定,主要包括有明确的主体失范事件描述、有第三方的评价或评论等。经过筛选和纳入,本研究最终共获得563份文本资料,其中529份用于影响因素的提取,剩余34份用于饱和度检验。

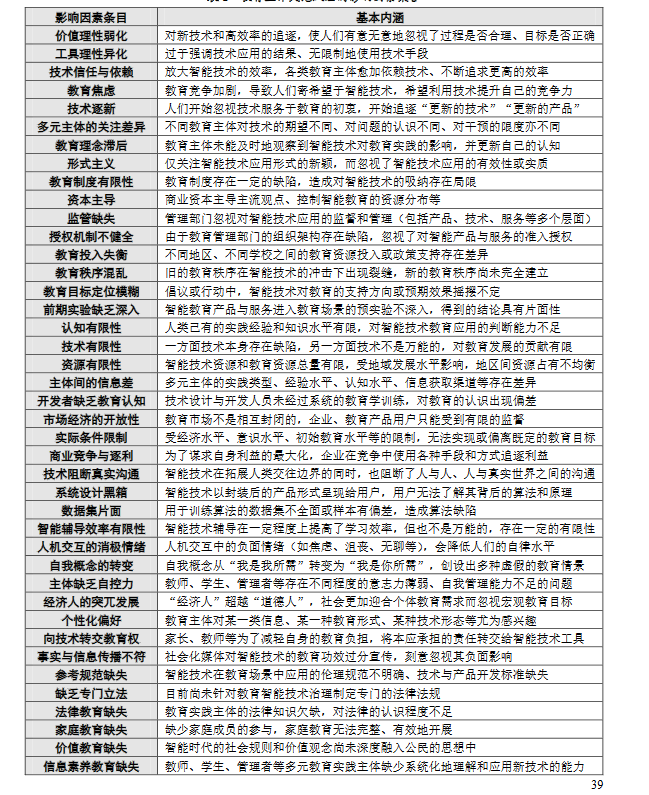

表 1 教育主体失范风险的影响因素集合

三 形成智能时代教育主体失范风险的影响因素集合

1 概念化抽取主体风险的影响因素

本研究采用概念提取的方式对访谈数据和客观数据进行分析,通过对数据进行编号、抽象 提炼、合并同类项,从中抽取智能技术环境下教育主体失范风险的影响因素。其中,主观的访谈数据以句子为抽取单位,而客观数据以条目(如一篇新闻报道、一篇研究文献)为抽取单位。 ①从访谈数据来看,教育主体较为关注自身或他者在应用智能技术过程中被动或主动的行为失范,其中对他者行为失范的认识更具体,且归因更客观,倾向于对人性、社会环境等展开分析,而对自身行为失范及其成因缺乏察觉。例如,区域管理者C在讨论教育场景中智能技术应用的监管问题时指出:“学生个人数据隐私泄露的问题严重。现在行政主管部门、教育主管部门的一些做法简单粗暴,比如说像学生的教育ID整个都到学校去(存储)了。学校有各种各样的管理部门,但是这些管理部门的老师对数据安全有没有一个很清晰的认识?这是存疑的……”——这可进一步提炼为“监管缺失”。②从客观数据来看,第三者的视角能够更加清晰地对智能技术引发的教育主体失范进行归因,且维度更加全面、论述更加客观。例如,教师、学生和家长作为智能教育产品的一线用户,对形式主义问题造成的管理者行为失范反应强烈。曾有家长向新闻媒体反映:在官僚主义风气的影响下,当前学校管理者关注且仅关注智能技术服务或产品的外显效果——是否漂亮、是否先进、是否高大上、是否能够取悦领导和上级部门等,而忽视了技术支持教育的本质在于从根本上提升教育质量——这可进一步提炼为“形式主义”;对智能教育产品与服务的关注主要集中在其有效性和有限性的冲突,虽然利用智能技术能够提升教育者的施教效率,但同样存在力所不及之处,如技术辅助系统过早地反馈学生的学习结果,阻止学生的深度思考或过早结束了其思维进程[20]——这可进一步提炼为“智能辅导的有效性与有限性”。通过对主观数据和客观数据进行概念提取与整合分析,本研究形成了教育主体失范的影响因素集合,共包含价值理性弱化、工具理性异化等41项影响因素条目,涉及个人意识、组织因素、客观规律、规范滞后、技术缺陷等多个维度,如表1所示。

2 从“人因何存在于技术风险之中”来分析上述影响因素

目前,对智能技术风险归因的相关研究大多从技术本身的缺陷(如数据集片面、算法黑箱)或教育主体本身的自制能力缺失等方面进行归因,而较少讨论制度设计、社会环境建设等客观因素的综合影响,且鲜少对不同影响因素之间的关系进行探讨,这直接导致在治理实践中难以统筹把控并实施系统化干预。可以说,无论是政策制定者还是实践者都容易迷失在对“影响因素”的主观讨论中,受制于个体有限的经验,而很难采用系统化思维推进治理实践。虽然这种将智能技术作为治理客体的视角能在一定程度上缓解当前教育领域面临的“科林格里奇困境”, 但无法从根本上系统地化解智能时代教育发展所面临的危机。区别于已有研究对技术本身的过度关注和强烈的干预意愿,本研究提取出的教育主体失范影响因素更多地聚焦于“人因何存在于风险之中”。人的行为通常具有多维度、可变性的特征,因此有必要对所有影响主体失范的因素进行结构化分析,从更加宏观和全面的维度了解影响因素之间的层次关系、强弱关系,以有针对性地制定策略,以干预失范行为之间的演化(如从“背离伦理规范的行为失范”向“触犯底线原则的行为失范”演化),从而更加彻底地预防行为失范的发生。通过对上述教育主体失范风险影响因素的分析,可以发现:不同教育主体的失范表现存在差异,且不同类型的失范成因不同,如背离伦理规范的失范主要受价值理性弱化、工具理性异化、教育焦虑等因素的影响,而触犯法律底线的失范主要受缺乏专门立法、法律教育缺失等因素的影响。在明晰智能技术引发教育主体失范风险影响因素的基础上,本研究引入原则导向的智能技术治理理论,在智能技术实现的理想状态与现实状态之间创造出一定的制度空间,提供原则框架和工具选择,有望实现智能技术的教育应用在道德价值、技术要求和法律要求之间的调和[21]。

四 构建教育领域中生成式人工智能的多层次治理模型

在厘清教育主体失范风险影响因素的基础上,有针对性地设计治理机制和干预措施,能够最大程度地降低新兴技术对教育发展的负面影响。为了更加聚焦地说明如何在明晰影响因素的基础上构建智能技术治理模型,本研究将近年来讨论较为激烈、对其治理过程和治理机制尚未形成一致论断的生成式人工智能(Artificial Intelligence Generated Content,AIGC)作为研究对象。结合上述对风险成因的分析,本研究构建了教育领域中生成式人工智能的多层次治理模型,并提出了实施生成式人工智能常态化治理的实践路径。

1 构建教育领域中生成式人工智能的多层次治理模型

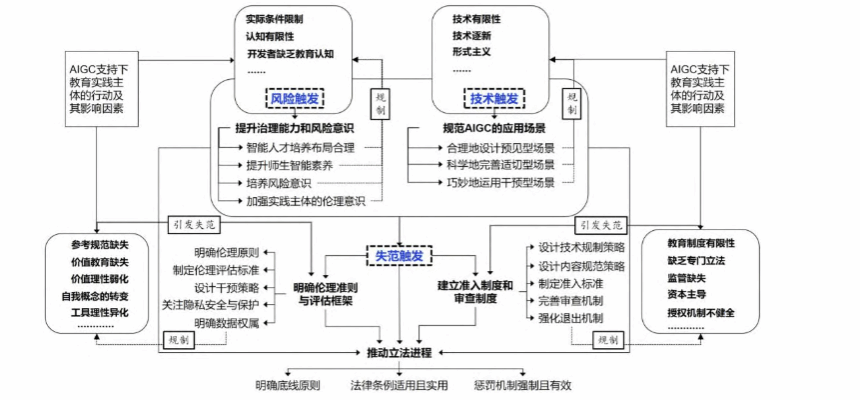

智能技术引发教育主体失范风险的基础性影响因素主要有教育制度有限性、认知有限性、技术有限性、开发者缺乏教育认知、实际条件限制、参考规范缺失、缺乏专门立法、价值教育缺失等。对造成教育主体失范风险的影响因素进行治理,是解决智能技术应用问题的有效途径。而“教育领域中智能技术治理”是指为了安全、高效地使用智能技术,避免由于其应用失范导致的教育问题,教育领域中的各利益相关者采用多种方式共同管理智能技术在教育领域中的设计、开发与应用等行为,并为此付出持续努力的过程。在教育领域中开展智能技术治理的目的,是实现智能技术安全、高效的应用,避免或解决由于技术应用失范导致的教育主体行为异化。基于此,本研究尝试通过干预上述基础性的影响因素,并以智能技术中的 AIGC 技术为例,来构建教育领域中生成式人工智能的多层次治理模型。AIGC 应用不当引发的教育问题和社会问题层次多样、类型多元,且牵涉的主体众多,在国家层面相关政策的加持下,其负面影响的传播力较以往更大[22],因此需要寻找更为有效的治理理论来解决AIGC的治理问题:①AIGC引发的问题层次较为多样、涉及的主体类型众多且所涉部门繁杂、公私利益博弈复杂,而多层次治理理论能够提供实践指导。多层次治理是政府、市场及社会等不同层次的主体各司其责,是多元主体协同治理的重要实践形式,通常以协议的方式、扮演适当的角色参与治理过程[23]。②人工智能治理、互联网治理、大数据治理等新型全球治理议题往往涉及的治理领域较为宽泛、参与治理的主体多元、议题多样,没有一种治理理论可以解释和解决所有问题——同样的,也没有一种体制可以独立地对所有的议题进行治理,因此需要借助体制复合体理论指导实践。体制复合体理论是应用体制理论在分析复杂的全球治理问题时产生的一种理论视角,倡导将多种体制理论、多种治理理论进行整合应用,从而解决新兴信息技术带来的复杂治理体,适用于分析和解决复杂的社会治理问题,尤其是新技术引发的社会问题[24]。依托上述理论,结合对多元教育主体失范风险影响因素的分析,本研究构建了教育领域中生成式人工智能的多层次治理模型,如图1所示。在多种影响因素的综合作用下,该模型形成了风险触发、技术触发、失范触发三种 AIGC 应用主体失范行为的触发形式。同时,该模型针对不同类型的失范问题列出了相应的治理策略,如提升治理能力和风险意识以减少风险触发等。

图 1 教育领域中生成式人工智能的多层次治理模型

在实践中,不同的教育主体要根据自身角色选择恰当的行动策略:政府要牢牢把握生成式 人工智能与教育行业结合的发展方向,为行业制定统一的安全标准、法律规范、准入制度和审查机制;企业作为 AIGC 的创新者、使用者和拥有者,既要承担新技术研发的责任,也要承担相应的社会责任,开展公开、透明、严格的自我监管,并积极参与同行监督、标准监督、体制监督等;社会组织、机构、团体和个人也要积极地参与相关规则的制定、监督和执行,以共同推动形成一个治理层级丰富、参与主体多元、功能覆盖完全、责任清晰明确、规则合理有效的协同教育智能技术治理体系。同时,在体制复合体理论的指导下,教育领域中智能技术治理需要根据不同的治理内容、治理目标,恰当地结合伦理原则、技术标准、社会规范、政策条例、法律法规等不同层次的治理机制,最终通过各机制之间的松散耦合形成集合体。此外,还可以通过明确影响因素、梳理触发类型、提出治理策略、推动主体行动、有效开展治理效果评估等多个治理环节,来有针对性地弱化或消解 AIGC 引发的背离伦理规范、违反行业与技术标准、脱离制度约束、触犯法律底线四种类型的教育主体失范问题。

2 实施生成式人工智能常态化治理的实践路径

AIGC 在教育领域的应用催生了很多的问题,这些问题不仅包括技术自身缺陷导致的问题,而且涉及各类教育主体在面对AIGC这一新生事物时进行探索、试错时产生的过程性失范。无论是技术触发的风险问题,抑或主体失范引发的风险问题,都需要从系统层面探索 AIGC 的技术治理之道,这通常涉及伦理、标准、制度、法律等多个层面的实践策略。

(1)建立伦理规范:提供AIGC多元应用主体的“自律”参考框架

荷兰技术哲学家 Brey 提出的预知性技术伦理,倡导在研发阶段便关注技术进入社会将引发的社会问题,以最大程度上避免技术伦理风险[25],这一问题解决思路在 Swierstra 提出的预判性技术伦理中同样得到了印证[26]。基于上述成果,研究者和实践者可以联合起来应对智能技术引发的主体伦理失范风险,通过制定一系列清晰的伦理准则(如尊重人权、保护隐私、确保公正和透明、确保安全和可靠等),来指导教育领域中AIGC开发过程中的决策选择,以从最初阶段开始干预,避免“科林格里奇困境”的产生,解决智能技术环境下教育主体面临的现实问题;同时,通过将伦理问题的规制进行前置,来最大程度地解决因决策主体缺乏伦理意识而造成的 伦理困境[27],避免由于外部社会环境的变化、制度缺失等客观原因造成的道德缺失[28]。参考这一思路,可以通过将AIGC在教育场景不同阶段可能面临的伦理问题纳入研发阶段,构建完善的AIGC伦理价值体系,来干预 AIGC 在不同教育场景中的渗透方式。在具体操作方面,可以利用行动者网络理论完善责任分配,构建“伦理清单”,建立包含危害与风险、权力与责任、教育规律、教育目标等多元视角的伦理规范,明确不同的教育实践主体在不同的智能技术应用场景中需要遵循何种原则,从而将伦理责任的划分进行前置,即在技术设计阶段就渗透治理原则、价值选择等,避免出现后期难以纠正的问题,从而消解AIGC在教育领域应用与发展的“科林格里奇困境”[29]。同时,制定相关的规制标准,如建立早期道德评估标准,意识到技术与社会互动产生的重大影响,并将技术系统的设计置于道德评估之前,构建一套技术支持的可追溯系统,以开展过程性评估和参与性评估[30]。

(2)设计监管机制:完善多元主体的“他律”机制

完善监管机制、制定监测标准和参照标准,是以政府相关部门为主导、多元主体协同参与AIGC治理的共同责任,同时也是实施 AIGC 治理时教育主体开展“他律”的制度基础和重要依据。以生成式短视频的用户沉迷为例,应该充分运用系统思维,在创新发展与社会公平正义之间寻求动态平衡,如确保底层人民的信息权益,避免受到劣质内容的负面影响,这需要利用国家层面的监管力量,对那些明显不正当使用AIGC生成短视频内容的企业行为和严重的侵权行为加强监管,同时对平台垄断、侵害用户权益等方面的行为展开治理,要求那些不符合教育规律和相关标准的智能教育产品与服务强制性退出市场。目前,相关政府部门已经意识到了在智能技术治理过程中对主体实施监管的重要性,故开展了一系列落地行动,如在组织机构建设方面,教育部成立了校外教育培训监管司,主要职责是承担面向中小学生(含幼儿园儿童)的校外教育培训管理工作,指导校外教育培训机构的建设,制定校外教育培训规范管理政策;针对教育培训中的 AIGC 技术应用,国家有关部门会同专家团队制定校外教育培训(含线上线下)机构设置、培训内容、培训时间、人员资质、收费监管等方面相关的标准和制度并监督执行, 从更加全面的角度组织实施校外教育培训中AIGC的综合治理,同时指导、规范面向中小学生的社会竞赛等。需要指出的是,“自律”与“他律”结合的关键,在于坚持技术应造福人类、可持续发展、公众利益优先、共享科技红利等伦理原则,并通过制度安排、产品设计和服务规范,将这些伦理原则嵌入 AIGC 研究与应用的各个环节。

(3)推动立法进程:以智能教育领域的专门立法保障教育主体行为牢守“底线原则”

伦理规范是教育主体开展基于技术的实践中完成自律的参照系,通常反映在道德层面,是一种向内的自我约束机制;而国家层面制定并颁布的一系列标准、评估方案、监管机制等,是一种由外向内的约束机制——这两种机制对教育主体的行为规范都处于“建议”层面,约束性较弱,其中伦理规范几乎没有强制性,绝大程度上需要依赖主体的自觉。因此,需要辅以专门的立法来强化约束机制,确保教育主体在使用AIGC开展活动的过程中能够牢守“底线原则”,即不违反网络安全法律法规、不触犯知识产权法等。AIGC的技术跃进,架空了个人信息处理的告知同意规制和最小必要原则,引发了虚假信息生成、个人信息泄露的广泛风险迭代问题。在数据保护方面,《中华人民共和国数据安全法》对数据生产、使用、传播等过程中涉及的主体进行了规范,提供了一系列需要遵循的原则,如政府层面由国家安全领导机构负责制定决策、建立安全协调机制,生产数据的机构和部门承担安全监管的职责,个人在开展数据处理的活动中应遵守法律法规、尊重社会公德和伦理、遵守商业道德和职业道德,有关部门、行业组织、科研机构、企业、个人等有义务和责任共同参与数据安全保护工作并提升保护意识和能力等[31]。

(4)落实实际行动:以教育社会实验为抓手推动多元主体参与的常态化治理

教育社会实验能够在更大范围内利用更科学的方法和策略探索智能技术治理的有效方案。 当前,从国家层面到组织机构、学校再到家庭、个人,都开始逐渐意识到互联网、大数据、人工智能等技术所营造的虚拟空间对未成年人产生了重要影响,且这种影响的力度甚至已经超过了可眼见、可触摸的真实世界的影响,因此有必要对教育领域的智能技术治理进行立法规制,同时也需要多元主体共同行动起来。基于此,多元主体应在各自的责任范围内,积极参与 AIGC的治理进程,探索参与教育领域 AIGC 治理的有效策略,具体包括:①企业主体应积极配合网络环境整治,遵守技术开发标准、技术应用的伦理规范,不触犯法律底线,承担社会责任,提供内容健康、形式合理的智能教育资源,积极接受国家相关部门与公众的监督;②学生家长应关注儿童接触的技术工具,确保内容适切和网络环境健康,提升对 AIGC 的认知和风险意识,不传播、不侵犯孩子的个人隐私,保护好个人数据,善于利用法律武器维护教育环境的健康稳定,针对孩子在技术应用过程中出现的问题给予即时反馈、合理干预;③区域教育管理者应完善项目审核与技术引进,遵守行业要求与规范,遵守底线原则和法律要求,制定清晰的标准体系,建立师生信息素养培训体系,开发资源库、含有技术风险与伦理规范类内容的教育课程,建立AIGC教育实验基地,开展技术推广前的深度实验;④高校科研工作者应从理论层面开展教育智能技术治理的相关研究,为教育领域 AIGC 伦理规范的制定提供参考,并积极参与国家教育智能技术治理的政策咨询与政策制定,开发测量工具,为AIGC应用的失范行为监测、干预提供依据;⑤一线教师应积极开展技术伦理类课程教学,负责任地在教学中安全、健康地使用 AIGC,同时努力提升自身智能素养,并帮助学生提升智能素养;⑥社会组织机构与场馆工作人员应时常关注 AIGC 的应用,开发、设计相关的课程,积极开展宣传活动,普及风险意识、伦理规范、法律常识等。发挥不同教育主体的实践优势,能够最大程度地提升教育领域智能技术的治理效率。

五 结语

在教育数字化转型过程中,智能技术发挥了举足轻重的作用。与此同时,由于受技术有限性、教育主体的意识或理念存在偏差等因素的影响,智能技术引发了一系列教育主体失范行为。对教育主体失范风险进行治理,尤其是对多元技术主体进行规制,是推进智能教育健康发展、确保智能技术有效且深入地应用于教育场景的前提。本研究通过对现实问题的分析,梳理了当下智能技术在教育领域中应用引发的问题,如主体失范、异化等现象;在了解多元主体主观认识、进行客观资料分析等的基础上,本研究提出了造成当前智能技术引发教育主体失范的影响因素。对这些问题的回应,是本研究进行AIGC多层次治理的基础。本研究期望通过探索符合当下中国教育实践和本土实情的AIGC常态化治理的实践路径,可以为国家在教育智能产品的市场准入与监管等方面的政策制定、伦理准则明确、立法进程推动等提供理论参考。在未来的研究中,可以关注发生在较大范围、涉及较广区域、包含较多影响群体的智能教育改革,从教育社会实验的视角研究其发生机制、运行机制、干预机制,从而推动我国智能教育的安全、健康、可持续发展。

参考文献

[1]逯行,黄荣怀.智能时代的教育改革:教育社会实验的演化及其价值回应[J].清华大学教育研究,2022,(1):42-54.

[2]何勤,朱晓妹.人工智能焦虑的成因、机理与对策[J].现代传播(中国传媒大学学报),2021,(2):24-29.

[3]唐汉卫.人工智能时代教育将如何存在[J].教育研究,2018,(11):18-24.

[4]周利敏,钟海欣.社会 5.0、超智能社会及未来图景[J].社会科学研究,2019,(6):1-9.

[5]逯行.智能技术引发的教育主体行为失范如何判定:方法、类型与表现[J].现代远程教育研究,2022,(2):37-46.

[6]欧亚琴.风险与匡正:智能推荐主导下的青年价值观建设[J].湖北师范大学学报(哲学社会科学版),2022,(3):141-146.

[7]王旦,张熙,侯浩翔.智能时代的教育伦理风险及应然向度[J].教育研究与实验,2021,(4):34-39、96.

[8]韦妙,何舟洋.本体、认识与价值:智能教育的技术伦理风险隐忧与治理进路[J].现代远距离教育,2022,(1):75-82.

[9]沈正赋.论算法的功能纠偏、技术偏向及其对舆论引导的影响[J].内蒙古社会科学,2022,(3):171-178.

[10]姜晨,颜云霞.“何以向善”:大数据时代的算法治理与反思——访上海交通大学媒体与传播学院教授陈堂发[J].传媒观察,2022,(6):36-41.

[11]周江林.数据治理:大数据时代“双一流”建设的路径优化取向[J].教育发展研究,2022,(5):15-21.

[12]王辞晓,徐珺岩,郭利明,等.多场景人机协同在线教学评价框架研究——基于层次分析法和熵权法的分析[J].现代教育技术,2023,(1):74-82.

[13]董文娟,黄尧.人工智能赋能职业教育:实质、路径与目标[J].现代教育技术,2019,(10):28-33.

[14]刘济良,马苗苗.智能时代下教育的困境与坚守——基于生命哲学的视角[J].教育发展研究,2021,(20):1-8.

[15]侯红霞,梁欢欢.系统思维视阈下人工智能发展的伦理困境分析[J].系统科学学报,2021,(4):51-55、67.

[16]赵磊磊,张黎,王靖.智能时代教育数据伦理风险:典型表征与治理路径[J].中国远程教育,2022,(3):17-25、77.

[17]钟正,王俊,吴砥,等.教育元宇宙的应用潜力与典型场景探析[J].开放教育研究,2022,(1):17-23.

[18]郑旭东,狄璇,岳婷燕.区块链赋能区域教育治理:逻辑、框架与路径[J].现代远程教育研究,2022,(1):31-39.

[19](美)赫伯特·J.鲁宾,艾琳·S.鲁宾著.卢晖临,连佳佳,李丁译.质性访谈方法:聆听与提问的艺术[M].重庆:重庆大学出版社,2016:20-25.

[20]申灵灵,何丽萍.人工智能时代技术与教育共生的困局与出路[J].高教探索,2021,(9):13-18.

[21]徐玖玖.人工智能的道德性何以实现?——基于原则导向治理的法治进路[J].现代法学,2021,(3):24-40.

[22]管其平.智能社会学:智能时代社会学研究的新方向[J].华南理工大学学报(社会科学版),2022,(3):1-9.

[23]张文静,沈克印.乡村振兴战略下农村公共体育服务的协同治理研究——基于多元主体协同治理模型[J].沈阳体育学院学报,2020,(3):35-42.

[24]鲁传颖,(美)约翰·马勒里.体制复合体理论视角下的人工智能全球治理进程[J].国际观察,2018,(4):67-83.

[25]顾世春.荷兰预判性技术伦理思潮研究[J].大连理工大学学报(社会科学版),2018,(4):114-119.

[26]顾世春.斯威斯卓预判性技术伦理研究[J].自然辩证法研究,2018,(12):29-33.

[27]侯红霞,梁欢欢.系统思维视阈下人工智能发展的伦理困境分析[J].系统科学学报,2021,(4):51-55、67.

[28]王丹丹,黄志南.人工智能时代高校道德教育实践模型研究[J].现代教育技术,2022,(7):101-108.

[29]文成伟,汪姿君.预知性技术伦理消解 AI 科林格里奇困境的路径分析[J].自然辩证法通讯,2021,(4):9-15.

[30]Buckley J A, Thompson P B, Whyte K P. Collingridge’s dilemma and the early ethical assessment of emerging technology: The case of nanotechnology enabled biosensors[J]. Technology in Society, 2017,48:54-63.

[31]中国人大网.中华人民共和国数据安全法[OL].

来源:知网 编辑:陈雨亭 校对:唐菁莲 初审:施羽晗 终审:聂竹明